-

Hà Nội và nhiều tỉnh thành “oằn mình” trong đợt nắng nóng đỉnh điểm, khi nào mới hạ nhiệt?

Hà Nội và nhiều tỉnh thành “oằn mình” trong đợt nắng nóng đỉnh điểm, khi nào mới hạ nhiệt? -

Đề xuất cấm người sinh từ năm 2010 mua, hút thuốc lá: Nhiều phụ huynh đồng loạt lên tiếng

Đề xuất cấm người sinh từ năm 2010 mua, hút thuốc lá: Nhiều phụ huynh đồng loạt lên tiếng -

Phụ huynh tố giáo viên người Ấn Độ tát học sinh lớp 4 nhập viện, công an chính thức vào cuộc

Phụ huynh tố giáo viên người Ấn Độ tát học sinh lớp 4 nhập viện, công an chính thức vào cuộc -

Toàn cảnh vụ triệt phá đường dây ma túy liên tỉnh cực lớn, tóm gọn 140 đối tượng tại TP.HCM

Toàn cảnh vụ triệt phá đường dây ma túy liên tỉnh cực lớn, tóm gọn 140 đối tượng tại TP.HCM -

Kim Soo Hyun nhập viện điều trị tâm lý giữa khủng hoảng, diện mạo hiện tại khiến nhiều người ngỡ ngàng

Kim Soo Hyun nhập viện điều trị tâm lý giữa khủng hoảng, diện mạo hiện tại khiến nhiều người ngỡ ngàng -

Kỳ án hôn nhân nghìn tỷ: 10 năm hầu tòa và những nút thắt ly kỳ của bác sĩ nha khoa

Kỳ án hôn nhân nghìn tỷ: 10 năm hầu tòa và những nút thắt ly kỳ của bác sĩ nha khoa -

Cuộc đua nghẹt thở vào lớp 10 chuyên tại Hà Nội và TP.HCM chính thức bắt đầu

Cuộc đua nghẹt thở vào lớp 10 chuyên tại Hà Nội và TP.HCM chính thức bắt đầu -

Từ tháng 6, nghệ sĩ và KOL sai phạm sẽ đối mặt với "danh sách đen"

Từ tháng 6, nghệ sĩ và KOL sai phạm sẽ đối mặt với "danh sách đen" -

Chiếc Maybach tháo bánh của bà Trương Mỹ Lan chốt giá gấp đôi, hai xe sang khác "ế ẩm"

Chiếc Maybach tháo bánh của bà Trương Mỹ Lan chốt giá gấp đôi, hai xe sang khác "ế ẩm" -

Việt Nam lên tiếng trước cáo buộc của Mỹ nhắm vào Đại tướng Raul Castro

Việt Nam lên tiếng trước cáo buộc của Mỹ nhắm vào Đại tướng Raul Castro

Công nghệ

23/08/2024 15:23Hacker dùng 'câu lệnh bẩn' để tấn công trợ lý ảo AI

Số lượng cuộc tấn công liên quan đến trí tuệ nhân tạo (AI) đang leo thang nhanh chóng. Thông tin này vừa được Kaspersky chia sẻ tại Hội nghị thượng đỉnh trọng điểm về an ninh mạng diễn ra hồi đầu tháng 8 tại Sri Lanca.

Theo các chuyên gia, có thể chia các cuộc tấn công bằng AI thành hai loại chính. Đầu tiên là sử dụng AI để tự động hóa quy trình hoặc tìm ra các phương thức tấn công mạng mới. Ví dụ điển hình là cách mà nhiều kẻ lừa đảo sử dụng công nghệ Deepfake. Thể loại tấn công bằng AI thứ hai là lợi dụng lỗ hổng để thao túng các mô hình ngôn ngữ lớn thực hiện hành động ngoài ý muốn.

Trên thực tế, sự phát triển nhanh chóng của trí tuệ nhân tạo thời gian gần đây đang đặt ra những thách thức với ngành bảo mật. Theo kết quả một nghiên cứu vừa công bố của Kaspersky, AI có thể bẻ khóa mật khẩu nhanh hơn 3 lần so với cách thông thường. Nguy hiểm hơn khi 78% mật khẩu có thể bị AI bẻ khóa trong vòng chưa đầy 60 phút.

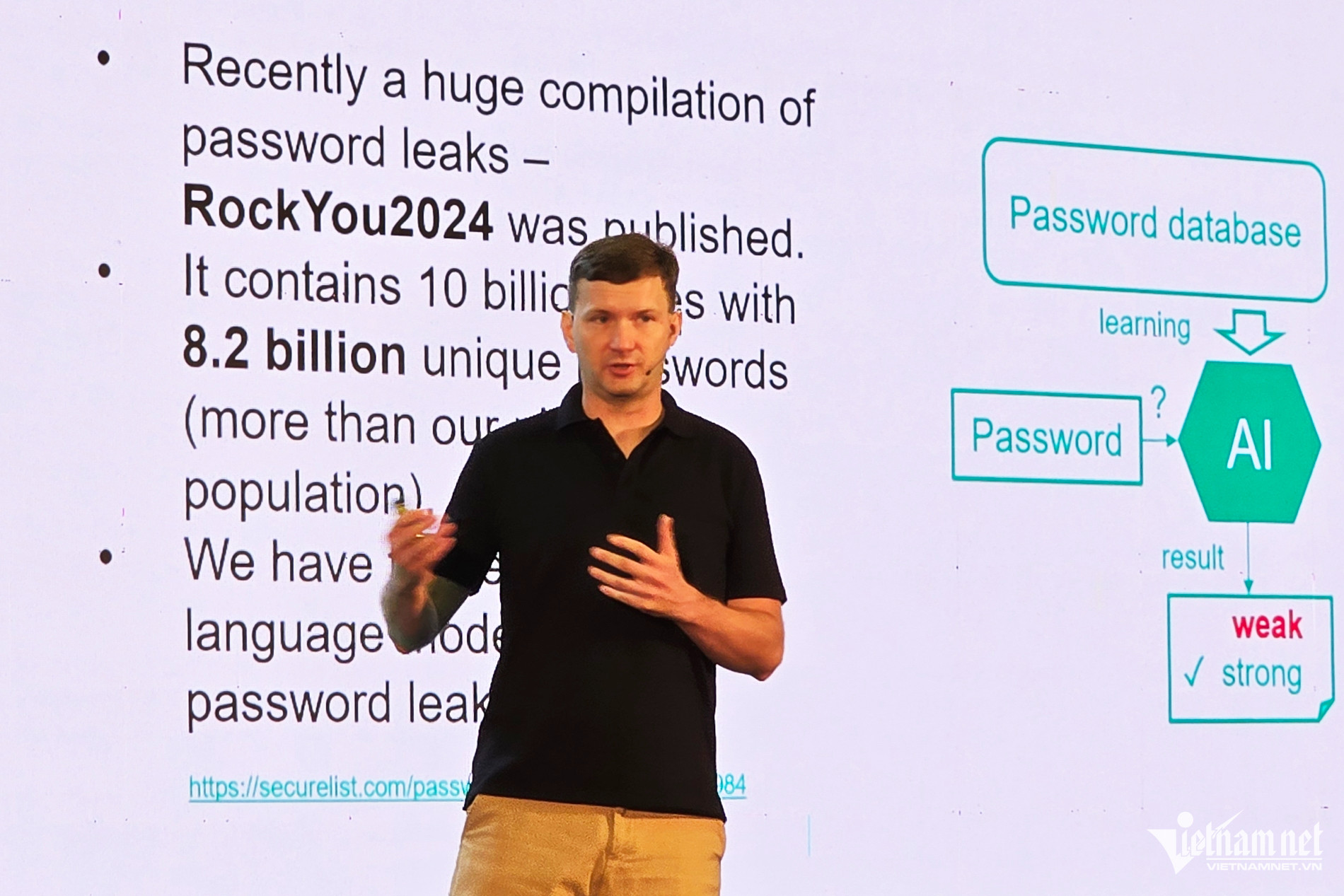

Tháng 7 vừa qua, thế giới chứng kiến vụ rò rỉ mật khẩu lớn nhất từng bị phát tán trực tuyến. Đó là vụ rò rỉ mật khẩu RockYou2024, chứa 10 tỷ mật khẩu dưới dạng văn bản và 8,2 tỷ mật khẩu chứa ký tự đặc biệt.

Phân tích dữ liệu thu được từ sự cố này, ông Alexey Antonov - Trưởng nhóm Khoa học Dữ liệu tại Kaspersky, cho biết 32% mật khẩu người dùng hiện không đủ mạnh. Dù đã được mã hóa ở dạng “hàm băm”, nhưng những mật khẩu này vẫn có thể khôi phục về dạng văn bản thuần túy. Bằng thuật toán đơn giản, công đoạn khôi phục chỉ mất khoảng 60 phút.

“Để kiểm tra mức độ bảo mật của mật khẩu, chúng tôi đào tạo mô hình ngôn ngữ (language model) dùng các mật khẩu đã lộ làm dữ liệu đầu vào. Kết quả là, có đến 78% mật khẩu có khả năng bị bẻ khóa theo cách kể trên. Chỉ có 7% mật khẩu đủ mạnh để phòng chống các cuộc tấn công lâu dài”, chuyên gia Alexey Antonov nhận định.

Không chỉ sử dụng để dò tìm mật khẩu, trí tuệ nhân tạo đang được các hacker vận dụng vào nhiều kịch bản tấn công. Trên thực tế, ChatGPT có thể bị kẻ xấu lợi dụng để viết các phần mềm độc hại.

Thông qua AI, kẻ xấu khai thác các nội dung lừa đảo, bao gồm văn bản, hình ảnh, âm thanh và video để triển khai tấn công phi kỹ thuật. Những mô hình ngôn ngữ lớn như ChatGPT-4o đang bị tận dụng để tạo ra kịch bản và tin nhắn lừa đảo vô cùng tinh vi.

Vượt qua rào cản ngôn ngữ, AI có thể viết ra một email chân thật, chỉ cần dựa vào thông tin trên mạng xã hội. Thậm chí, AI có thể bắt chước văn phong của nạn nhân. Điều này càng khiến hành vi lừa đảo khó bị phát hiện hơn.

Một trong những nguy cơ từ AI là việc kẻ xấu lợi dụng công nghệ Deepfake để mạo danh người khác, từ đó thực hiện các hành vi lừa đảo nhằm trục lợi tài chính thông qua việc gọi điện cho bạn bè, người thân.

Theo chuyên gia Alexey Antonov, ngoài việc lợi dụng công nghệ AI vào những hoạt động phi pháp, kẻ xấu còn có thể tấn công vào cả những thuật toán AI. Điều này được thực hiện thông qua những cuộc tấn công “tiêm lệnh” (Prompt Injection attacks), nhập những câu lệnh độc hại, đi ngược những quy tắc hạn chế vào các mô hình ngôn ngữ lớn. Những “câu lệnh bẩn” sẽ tác động, làm sai lệch nội dung kết quả trả về của trợ lý ảo.

Bên cạnh đó, trí tuệ nhân tạo còn có thể được sử dụng trong các cuộc tấn công đối kháng (Adversarial attacks). Đó là khi kẻ xấu thêm những trường thông tin ẩn vào hình ảnh, hoặc âm thanh, để gây ảnh hưởng đến khả năng phân loại hình ảnh của hệ thống học máy.

Trong bối cảnh AI dần được tích hợp vào mọi khía cạnh trong đời sống con người, từ Apple Intelligence, Google Gemini cho đến Microsoft Copilot, các chuyên gia cho rằng, việc giải quyết những lỗ hổng AI nên được xem là ưu tiên hàng đầu.

Theo Trọng Đạt (VietNamNet)

- Bruno độc chiếm kỷ lục kiến tạo ở Premier League (24/05/26 23:55)

- Cristiano Ronaldo không được chọn vào đội hình xuất sắc nhất lịch sử World Cup (24/05/26 22:33)

- Petrolimex giải đáp xe còn xăng cũ có cần xả sạch bình trước khi đổ xăng E10, 1 số lưu ý quan trọng (24/05/26 22:08)

- Dự báo thời tiết ngày mai 25/5: Ngỡ ngàng với mức nhiệt cao nhất ở Hà Nội? TP.HCM có mưa rào, dông rải rác (24/05/26 21:55)

- Nam sinh sốc nhiệt nặng, suy đa cơ quan sau khi chơi bóng giữa nắng nóng (24/05/26 21:13)

- Đà Lạt: Thông tin mới nhất về vụ bé gái 13 tuổi bị nước lũ cuốn trôi khi đang chơi ở vườn (24/05/26 20:55)

- HLV Indonesia báo tin không vui, ĐT Việt Nam thêm cơ hội bảo vệ chức vô địch ASEAN Cup (24/05/26 20:44)

- Xe điện mới giá rẻ chỉ 251 triệu đồng: Sedan cỡ D "ngập tràn" công nghệ "đấu" Toyota Camry và Kia K5 (24/05/26 20:31)

- VinFast VF 8 mới có gì khác đời cũ: SUV hạng D giá rẻ hơn, nhẹ hơn, chạy 500 km mỗi lần sạc (24/05/26 20:07)

- Ô tô bốc cháy ngùn ngụt sau khi đi qua đoạn đường phơi rơm rạ (24/05/26 19:37)

Bài đọc nhiều