-

Người mẹ bế 2 con nhỏ đi bộ dưới nắng nóng, từ chối mọi hỗ trợ đã đồng ý quay về Hải Phòng sau cuộc gặp này

Người mẹ bế 2 con nhỏ đi bộ dưới nắng nóng, từ chối mọi hỗ trợ đã đồng ý quay về Hải Phòng sau cuộc gặp này -

Cha chết lặng khi con gái báo tin "Bố ơi, mẹ và em cùng anh chị chết đuối rồi": Tiếng khóc của người ở lại

Cha chết lặng khi con gái báo tin "Bố ơi, mẹ và em cùng anh chị chết đuối rồi": Tiếng khóc của người ở lại -

Vụ nữ du khách kể chuyện "tâm linh" khi du lịch Ninh Bình: Người đăng có thể bị xử lý hình sự?

Vụ nữ du khách kể chuyện "tâm linh" khi du lịch Ninh Bình: Người đăng có thể bị xử lý hình sự? -

Xe tải lật nghiêng sau cú tông mạnh vào trạm cân, quốc lộ 5 tê liệt nhiều giờ

Xe tải lật nghiêng sau cú tông mạnh vào trạm cân, quốc lộ 5 tê liệt nhiều giờ -

Hà Nội tạm cấm, hạn chế nhiều tuyến đường trong hai ngày 7-8/6

Hà Nội tạm cấm, hạn chế nhiều tuyến đường trong hai ngày 7-8/6 -

Vợ Thiếu tá công an hy sinh khi truy bắt "cát tặc" được tuyển dụng vào lực lượng Công an nhân dân

Vợ Thiếu tá công an hy sinh khi truy bắt "cát tặc" được tuyển dụng vào lực lượng Công an nhân dân -

Mỹ và Iran đối đầu nảy lửa tại eo biển Hormuz, không kích dồn dập vào các mục tiêu chiến lược

Mỹ và Iran đối đầu nảy lửa tại eo biển Hormuz, không kích dồn dập vào các mục tiêu chiến lược -

Biểu tượng "chồng quốc dân" gọi tên Quang Hải: Bản lĩnh bảo vệ Chu Thanh Huyền trước mọi giông bão dư luận

Biểu tượng "chồng quốc dân" gọi tên Quang Hải: Bản lĩnh bảo vệ Chu Thanh Huyền trước mọi giông bão dư luận -

Lịch công bố điểm thi, điểm chuẩn lớp 10 năm 2026 của 34 tỉnh, thành

Lịch công bố điểm thi, điểm chuẩn lớp 10 năm 2026 của 34 tỉnh, thành -

Thực hư tin nhắn làm quen trong quá khứ của HIEUTHUHAI bất ngờ bị đào lại

Thực hư tin nhắn làm quen trong quá khứ của HIEUTHUHAI bất ngờ bị đào lại

Công nghệ

06/08/2021 22:48Apple quét iPhone, iCloud tìm ảnh lạm dụng trẻ em

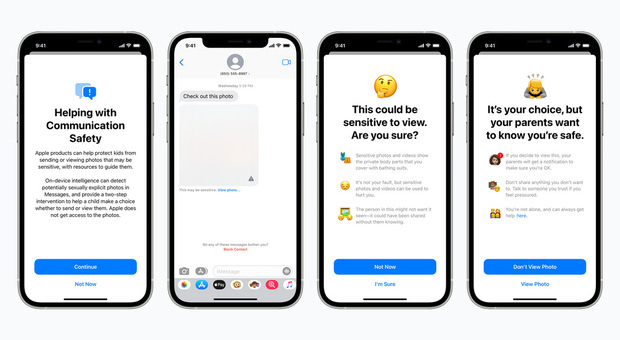

Cuối năm nay, Apple sẽ ra mắt công nghệ cho phép công ty phát hiện và báo cáo nội dung lạm dụng tình dục trẻ em (CSAM) cho nhà hành pháp. Trả lời TechCrunch, “Táo Khuyết” cho biết đây là một trong vài tính năng mới nhằm bảo vệ trẻ em tốt hơn trước các nguy cơ trực tuyến, bao gồm bộ lọc chặn hình ảnh khiêu dâm gửi và nhận qua tài khoản iMessage của trẻ. Một tính năng khác sẽ can thiệp khi người dùng cố tìm kiếm các từ khóa liên quan tới CSAM trên Siri và Search.

Tin tức về nỗ lực mới của Apple bị lộ ra sau khi Matthew Green, một giảng viên Mật mã học tại Đại học John Hopkins, đăng lên Twitter. Không chỉ vấp phải phản ứng từ một số nhà hoạt động quyền riêng tư và chuyên gia bảo mật, Apple còn bị người dùng phản đối. Theo Apple, công nghệ phát hiện CSAM mới - NeuralHash - sẽ hoạt động trên thiết bị người dùng và có thể phát hiện khi người dùng tải ảnh lạm dụng trẻ em lên iCloud mà không cần giải mã hình ảnh.

Apple đang cố xoa dịu cơn tức giận từ mọi người bằng cách nhấn mạnh tới nhiều lớp mã hóa để đảm bảo quyền riêng tư. NeuralHash sẽ có mặt trên iOS 15 và macOS Monterey trong 1 hoặc 2 tháng tới. Nó hoạt động bằng cách chuyển đổi hình ảnh trên iPhone hoặc Mac thành một chuỗi ký tự và số độc nhất vô nhị (hash). Bất cứ khi nào thay đổi hình ảnh, hash cũng thay đổi. NeuralHash muốn bảo đảm hình ảnh gốc và hình ảnh tương tự - chẳng hạn đã cắt cúp và qua chỉnh sửa - đều có chung hash.

Trước khi ảnh được tải lên iCloud Photos, các hash trên thiết bị sẽ được đối chiếu với một cơ sở dữ liệu các hash về ảnh lạm dụng trẻ em do các tổ chức bảo vệ trẻ em cung cấp. NeuralHash sử dụng kỹ thuật mật mã có tên private set intersection để phát hiện các hash khớp mà không tiết lộ hình ảnh là gì hay cảnh báo người dùng.

Apple có thể giải mã hình ảnh, xác minh thủ công nội dung, vô hiệu hóa tài khoản người dùng và báo cáo hình ảnh cho nhà chức trách. Theo công ty, tỉ lệ sai sót là 1/1.000 tỷ nhưng sẽ có quy trình kháng nghị.

Dù vậy, nhiều người cảm thấy không thoải mái khi trao dữ liệu cho một thuật toán. Vài chuyên gia bảo mật kêu gọi cần thảo luận trước công chúng trước khi Apple triển khai công nghệ này.

Theo Du Lam (ICTNews)

- Đào móng xây dựng khiến nhà hàng xóm nghiêng lún, hàng chục hộ dân phải sơ tán, chủ nhà lên tiếng (19:32)

- Bước ngoặt vụ nữ sinh bị sát hại "ngẫu nhiên" tại Hàn Quốc: Lật tẩy động cơ đê hèn của hung thủ (19:07)

- Chân dung nữ Chủ tịch CCV Group: Từ “để tôi vẽ hộ tương lai cho mọi người” đến lừa đảo nghìn tỷ (1 giờ trước)

- Hoa hậu Thùy Tiên có đủ điều kiện hưởng đặc xá năm 2026 hay không? (1 giờ trước)

- Các hãng ô tô công bố các mẫu xe dùng được xăng E10, 2 hãng nổi tiếng liệt kê danh sách nên cẩn trọng (1 giờ trước)

- Cái kết đắng cho cho hành vi rải vàng mã để "xả xui" ngay giữa trung tâm TPHCM (2 giờ trước)

- Hàng loạt mỹ phẩm nổi tiếng bị buộc thu hồi và tiêu hủy vì sai phạm của doanh nghiệp nhập khẩu (2 giờ trước)

- Sức ép từ nhóm bất động sản khiến VN-Index chìm trong sắc đỏ 7 phiên liên tiếp (2 giờ trước)

- Sân bay quốc tế Kuwait bị tàn phá nặng nề sau trận tập kích bằng UAV của Iran (2 giờ trước)

- Các quỹ kim loại quý đồng loạt bán tháo, thị trường vàng bạc chịu áp lực điều chỉnh (3 giờ trước)

Bài đọc nhiều