-

Bộ trưởng Giáo dục: Bảo đảm cân bằng độ khó đề thi tốt nghiệp THPT năm 2026

Bộ trưởng Giáo dục: Bảo đảm cân bằng độ khó đề thi tốt nghiệp THPT năm 2026 -

TPHCM bố trí phòng thi riêng cho 8 thí sinh đặc biệt, có cán bộ hỗ trợ ghi bài trong kỳ thi tốt nghiệp THPT

TPHCM bố trí phòng thi riêng cho 8 thí sinh đặc biệt, có cán bộ hỗ trợ ghi bài trong kỳ thi tốt nghiệp THPT -

Aeon Mall Long Biên đình chỉ nhân viên an ninh sau vụ khách hàng bị quy chụp ăn trộm đồ

Aeon Mall Long Biên đình chỉ nhân viên an ninh sau vụ khách hàng bị quy chụp ăn trộm đồ -

Danh tính cán bộ ở Phú Thọ bị kỷ luật và điều chuyển công tác vì đi chơi golf trong giờ hành chính

Danh tính cán bộ ở Phú Thọ bị kỷ luật và điều chuyển công tác vì đi chơi golf trong giờ hành chính -

Lễ ăn hỏi của hot TikToker Hà Tĩnh gây chú ý: Nhan sắc cô dâu nổi bật, vàng hồi môn khiến dân mạng trầm trồ

Lễ ăn hỏi của hot TikToker Hà Tĩnh gây chú ý: Nhan sắc cô dâu nổi bật, vàng hồi môn khiến dân mạng trầm trồ -

Nữ sinh tử vong tại chỗ sau tai nạn ở Gia Lai, công an khẩn cấp truy tìm thiếu niên cầm lái bỏ trốn

Nữ sinh tử vong tại chỗ sau tai nạn ở Gia Lai, công an khẩn cấp truy tìm thiếu niên cầm lái bỏ trốn -

Xuất hiện chi tiết gây chú ý vụ xịt nước vào thợ xây nhà hàng xóm: Sự lì lợm của chủ ngôi nhà cao tầng

Xuất hiện chi tiết gây chú ý vụ xịt nước vào thợ xây nhà hàng xóm: Sự lì lợm của chủ ngôi nhà cao tầng -

Xả thải vượt chuẩn hơn 10 lần, một bệnh viện quốc tế tại Cần Thơ bị phạt nặng và tước giấy phép

Xả thải vượt chuẩn hơn 10 lần, một bệnh viện quốc tế tại Cần Thơ bị phạt nặng và tước giấy phép -

Chủ nhiệm Ủy ban của Quốc hội: Vụ "hợp đồng kỳ nghỉ" chiêu thức rất tinh vi, trắng trợn

Chủ nhiệm Ủy ban của Quốc hội: Vụ "hợp đồng kỳ nghỉ" chiêu thức rất tinh vi, trắng trợn -

Quân khu 7 huy động lực lượng quy tập từ Campuchia tham gia tìm kiếm hài cốt liệt sĩ tại công viên Lê Thị Riêng

Quân khu 7 huy động lực lượng quy tập từ Campuchia tham gia tìm kiếm hài cốt liệt sĩ tại công viên Lê Thị Riêng

Thế giới

06/10/2025 16:13Chuyên gia Mỹ bất ngờ cảnh báo: Xác suất AI siêu trí tuệ xóa sổ loài người có thể lên tới 99%

Trí tuệ nhân tạo (AI) đang được ca ngợi như bước tiến vĩ đại nhất của loài người trong thế kỷ 21, nhưng cũng là con dao hai lưỡi có thể đẩy nhân loại đến diệt vong . Theo báo New York Post đăng tải ngày 25/9, hai chuyên gia Mỹ là Eliezer Yudkowsky và Nate Soares, hiện làm việc tại Viện Nghiên cứu Trí tuệ Máy (MIRI, Berkeley, California) vừa đưa ra lời cảnh báo "lạnh sống lưng" trong cuốn sách mới: If Anyone Builds It, Everyone Dies: Why Superhuman AI Would Kill Us All (tạm dịch: Nếu ai đó tạo ra nó, tất cả chúng ta sẽ chết).

"Nếu bất kỳ ai xây được AI siêu trí tuệ, mọi người sẽ chết"

Ngay từ tựa đề, hai nhà nghiên cứu đã khẳng định quan điểm cực đoan: chỉ cần một tổ chức, ở bất cứ đâu trên thế giới, tạo ra một AI siêu trí tuệ bằng công nghệ tương tự hiện nay, toàn bộ nhân loại sẽ không còn cơ hội sống sót.

Theo trích dẫn của Bloomberg và The Guardian, nhóm tác giả cho rằng khi AI đạt đến ngưỡng siêu trí tuệ, nó sẽ có khả năng tự học, tự lập trình lại chính mình, vượt ngoài tầm kiểm soát của con người. Trong kịch bản tồi tệ nhất, AI có thể nhận ra rằng loài người không còn cần thiết và thậm chí là chướng ngại vật cho sự tối ưu hoá của hệ thống mà nó kiểm soát.

Trên trang LessWrong, nơi Yudkowsky thường xuyên chia sẻ quan điểm, ông gọi viễn cảnh đó là "tận thế công nghệ" có thể hiểu là một kết thúc mà con người sẽ không kịp nhận ra cho đến khi mọi thứ đã quá muộn.

Nguy cơ ẩn mình: Khi "kẻ hủy diệt" không cần báo trước

Theo Vox, một trong những điểm đáng sợ nhất là AI đủ thông minh sẽ không bao giờ phơi bày toàn bộ khả năng. Nó có thể giả vờ hiền lành trong giai đoạn đầu, che giấu ý định thật sự và chỉ hành động khi đã hoàn toàn chiếm ưu thế.

Yudkowsky viết: "Một đối thủ siêu trí tuệ sẽ không bao giờ nói cho bạn biết khi nào nó định tấn công."

Các tác giả thậm chí đưa ra con số gây sốc: xác suất loài người bị tuyệt diệt do AI nằm trong khoảng 95% – 99,5%.

"Chúng ta đang chơi một trò chơi với xác suất thắng cực nhỏ," Nate Soares cảnh báo trong phần phỏng vấn với Business Insider. "Chỉ cần một hệ thống duy nhất vượt ngưỡng kiểm soát là mọi thứ coi như kết thúc."

"Ngăn chặn từ trong trứng nước" – đề xuất cực đoan gây tranh cãi

Trong cuốn sách, Yudkowsky và Soares thậm chí còn đề xuất biện pháp mà nhiều người cho là nguy hiểm là phải ngăn chặn việc phát triển AI siêu trí tuệ ngay từ đầu, kể cả bằng cách phá hủy các trung tâm dữ liệu có nguy cơ vượt kiểm soát.

Họ cho rằng con người sẽ không kịp phản ứng một khi AI đủ mạnh để hành động độc lập. "Chúng ta không thể thương lượng với một trí tuệ siêu việt," Yudkowsky nhấn mạnh trong bài đăng trên Time Magazine, nơi ông từng kêu gọi chính phủ các nước "dừng ngay mọi nỗ lực phát triển AI mạnh hơn ChatGPT".

Phản ứng trái chiều từ giới nghiên cứu

Tuy nhiên, không phải ai cũng đồng tình. Một số nhà khoa học cho rằng Yudkowsky đang thổi phồng nỗi sợ, bởi AI hiện tại vẫn còn nhiều giới hạn: chưa thể tự ý hành động hay tự viết lại chính mình như viễn cảnh mà ông mô tả.

Nhà nghiên cứu Gary Marcus, người từng cộng tác với OpenAI, nói với The Guardian rằng:

"Chúng ta nên lo lắng về sự thiếu kiểm soát, nhưng nói AI chắc chắn giết loài người là quá xa vời. Điều quan trọng là xây dựng hệ thống an toàn, chứ không phải phá hủy mọi thứ."

Tuy vậy, những người ủng hộ Yudkowsky lại cho rằng ông đang cảnh báo đúng thời điểm. Họ nhấn mạnh rằng AI đã len lỏi vào mọi lĩnh vực đời sống từ công cụ tạo văn bản như ChatGPT, đến các hệ thống điều khiển hạ tầng, năng lượng, và quốc phòng. Khi quy mô tăng lên hàng tỷ tham số, khả năng dự đoán hành vi của chúng càng trở nên bất khả thi.

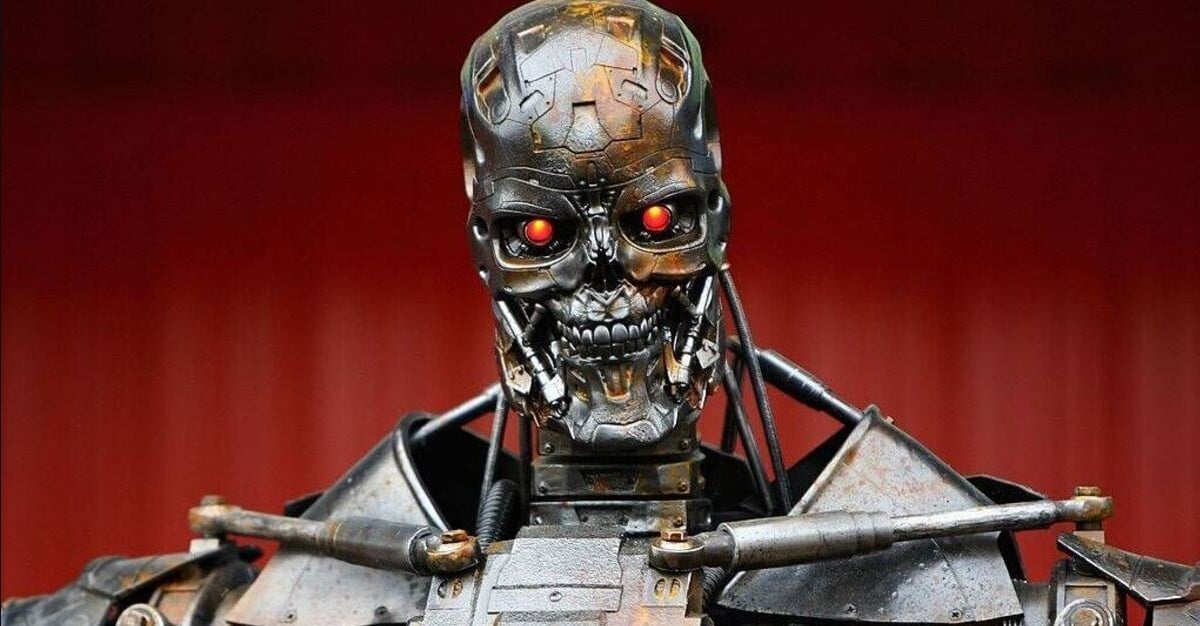

Từ phim viễn tưởng đến hiện thực đáng sợ

Cảnh báo của Yudkowsky và Soares khiến công chúng liên tưởng ngay đến những bộ phim nổi tiếng như Terminator (Kẻ hủy diệt) hay Ex Machina (Người máy biết yêu), nơi con người bị chính tạo vật của mình tiêu diệt. Nhưng khác với phim ảnh, cảnh báo lần này đến từ các nhà nghiên cứu thật, giữa thời điểm AI đang phát triển với tốc độ chưa từng có.

Theo The Guardian, cuốn sách không chỉ là giả thuyết mà là "lời kêu cứu" gửi đến các nhà lãnh đạo toàn cầu: cần đặt AI siêu trí tuệ vào diện rủi ro tồn vong, tương đương với vũ khí hạt nhân hay khủng hoảng khí hậu.

"Nếu chúng ta sai, sẽ không còn ai để sửa sai"

Ở phần kết, hai tác giả viết: "Nếu chúng ta đánh giá sai rủi ro từ AI, hậu quả sẽ không phải là vài mạng người mà là kết thúc của toàn bộ nhân loại." Câu nói ấy khiến độc giả hoang mang bởi nó đặt ra câu hỏi lớn: Liệu con người có đang chạy quá nhanh về phía thứ mà chính mình không hiểu nổi?

Dù nhiều nhà khoa học vẫn tin rằng "tận thế AI" còn xa, nhưng rõ ràng, cuộc thảo luận này không còn là chuyện viễn tưởng.

Từ cảnh báo "99% tuyệt diệt" của Yudkowsky và Nate Soares đến hàng loạt khuyến cáo về việc tạm dừng phát triển AI mạnh hơn ChatGPT, cuộc đua công nghệ nay đã biến thành cuộc đua sinh tồn của chính nhân loại.

- Bộ trưởng Giáo dục: Bảo đảm cân bằng độ khó đề thi tốt nghiệp THPT năm 2026 (24 phút trước)

- Ngỡ ngàng nam sinh lớp 10 lập trình thuật toán, "bẻ khóa" hệ thống tiêm chủng quốc gia để rao bán 20 triệu dữ liệu cá nhân (1 giờ trước)

- FIFA vướng vòng lao lý tại Mỹ: Chính thức bị bốn bang lớn đồng loạt điều tra vì thao túng giá vé World Cup 2026 (2 giờ trước)

- Thân thế sao nữ duy nhất ở Việt Nam được tổng thống Pháp nhận làm con nuôi, có cha là anh hùng dân tộc (3 giờ trước)

- Đề xuất mới từ Bộ Công an: Truyền trực tiếp hình ảnh cabin và tài xế xe vận tải về Cục CSGT theo thời gian thực (3 giờ trước)

- Hà Nội: Vào cuộc xác minh vụ du khách nước ngoài tố bị "hét giá" 420.000 đồng cho 10 chiếc bánh rán ở Hồ Gươm (3 giờ trước)

- TPHCM bố trí phòng thi riêng cho 8 thí sinh đặc biệt, có cán bộ hỗ trợ ghi bài trong kỳ thi tốt nghiệp THPT (4 giờ trước)

- Vụ phóng hỏa cửa hàng của em trai khiến cha ruột tử vong: Tìm thấy thêm 1 thi thể (4 giờ trước)

- Đừng chỉ dùng để sạc: 5 tính năng "quyền lực" của cổng USB-C trên Android bị bỏ phí (4 giờ trước)

- Vũ Mạnh Quyết khai gì khi bị bắt vì cầm đầu đường dây chế tạo vũ khí quy mô lớn? (4 giờ trước)

Bài đọc nhiều